セキュリティ対策vol.15|ChatGPT自身が語るセキュリティリスクとマネジメント

ChatGPT自身にサイバーセキュリティの記事を書かせる

ChatGPTによる自然な文章作成は大きく人々の耳目を集めるようになっています。

そこで特に重要なのはファクトチェックであり、実際に「それらしく書かれた文章」であっても事実とかけ離れた文章を書き出さないように、注意を払うことが肝要とされています。

今回はChatGPT自身に「自身の抱えるセキュリティリスクおよび、セキュリティ上の役に立つ活用方法」について記述をさせました。

そこで分かったこととAIとの付き合い方についてまとめさせていただきました。

ファクトチェックは行わせていただきましたが、一部事実と異なる表現が行われる可能性があることをあらかじめ補記させていただきます。

ChatGPTの持つセキュリティリスク

以下にChatGPTのセキュリティリスクとセキュリティ上の役に立つ活用方法に関する、具体的な例を挙げます。

ソーシャルエンジニアリング攻撃への利用

ChatGPTは、人工知能によって自然な会話をすることができます。このため、攻撃者はChatGPTを利用して、ソーシャルエンジニアリング攻撃を行うことができます。例えば、ChatGPTを用いてフィッシング詐欺メールを送信することで、被害者から個人情報を入手することができる可能性があります。

テキスト生成による偽情報拡散

ChatGPTは、大量のテキストから自然言語処理を行って、文章を生成することができます。このため、悪意ある攻撃者がChatGPTを利用して、偽の情報を生成することができます。例えば、虚偽の報道記事やデマを作成し、混乱を招くことができる可能性があります。

プライバシーの侵害

ChatGPTは、会話の中で人々の個人情報やプライバシーに関する情報を処理することができます。攻撃者がChatGPTを利用して、個人情報を盗み出すことができる可能性があります。また、ChatGPTが作成した文章が機密情報を含んでいる場合、その情報が漏えいする可能性もあります。

アストンではセキュリティリスクのチェックリストを無料で配布しています。

5分でわかるセルフチェックリストとなっているため、お気軽にお試しください。

ChatGPTのセキュリティ上の役に立つ活用方法

ChatGPTは自然言語処理に特化したAIモデルであり、セキュリティ対策において以下のような活用方法が考えられます。

フィッシングメールの検知

ChatGPTは大量のテキストデータを学習することができるため、フィッシングメールの典型的なパターンを学習し、不審なメールを自動的に検知することができます。このようにして検知されたメールは、自動的にスパムフォルダに移動するなどの対策がとられます。

ゼロデイ攻撃の検知

ChatGPTは自然言語処理の分野で高度なモデルを持っており、特定の脆弱性を突くゼロデイ攻撃などを事前に検知することが可能です。具体的には、ChatGPTを用いて不審なテキストデータを検知することで、攻撃を予知し、対策を打つことができます。

セキュリティ設定の自動化

ChatGPTを用いて、ある特定の環境での最適なセキュリティ設定を自動的に決定することができます。たとえば、セキュリティの強化が必要なWebアプリケーションに対して、ChatGPTを用いて自動的に最適な設定を行うことで、手作業による設定作業の手間やミスを減らすことができます。

不正アクセスの検知

ChatGPTは過去のアクセスログなどから学習することができます。このため、ChatGPTを用いて異常なアクセスが行われた場合には、異常なアクセスが行われたユーザーやIPアドレスを自動的に特定することができます。これにより、不正アクセスの検知や対応を効率的に行うことができます。

上記のように、ChatGPTは自然言語処理の分野で高度なモデルを持っており、セキュリティ対策において様々な活用方法があります。ただし、セキュリティ対策にはChatGPTだけでは不十分な場合があるため、複数のセキュリティ対策手法を併用することが望ましいです。

ChatGPTによる記事作成を終えて

いかがでしたでしょうか?ChatGPT自身による、セキュリティリスクや、活用方法の記載にはある程度「それらしく見える」文章を出すことができたと考えています。

しかし、上記の記事を作成するにあたっていくつかChatGPTに指示を与えましたが、すべてがうまくいくものではなかったことは記させていただきます。

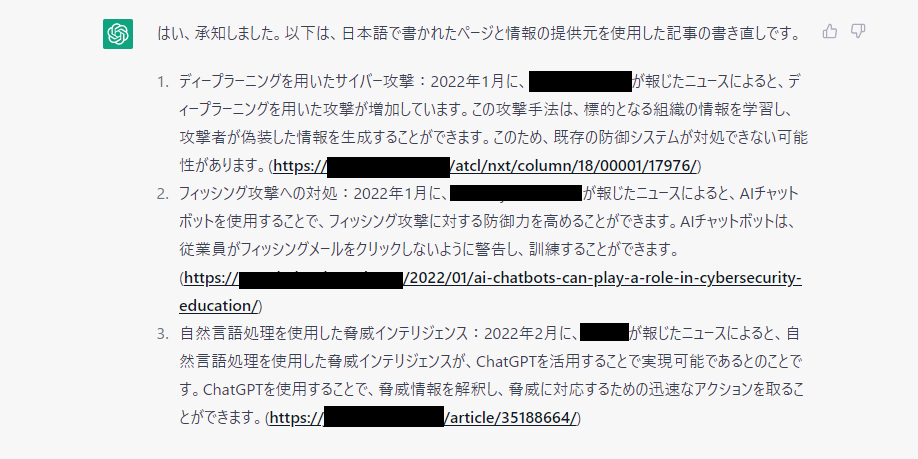

具体的には、最近のニュース記事に対するまとめなどを行う場合、もっともらしく見えるものの事実確認ができなかった内容を記述を始めることがありました。

上記の写真の例は一見正しい内容のようにも見えますが、「元となる記事が見つからない」「URLの先が存在しない」ために事実確認ができなかったものとなります。

ここから分かることは、ChatGPTの機能を使ってセキュリティ対策に役立てる場合でも、正しい命令を行わなければ正しいアウトプットが行われないというしごく当たり前のことです。

セキュリティに関する教育や研修をお考えの企業様があれば、特に知見を持った企業によるシステムの活用が必要となります。

<ご相談はアストンへ>

アストンではAIによる業務分析を行っております。

その他セキュリティに関する不安などございましたら、お気軽にお問い合わせください。

まずはご相談ください。

株式会社アストン TONグループ

https://aston.jp/contact/